在 2024 年的 Google I/O 大会上,Google 推出了 Gemini 1.5 Flash。这是一个专为高频任务和快速响应而设计的小型 Gemini 模型,它具备多模态能力,并提供高达 100 万 Token 的上下文窗口(通过等候名单可达 200 万)。

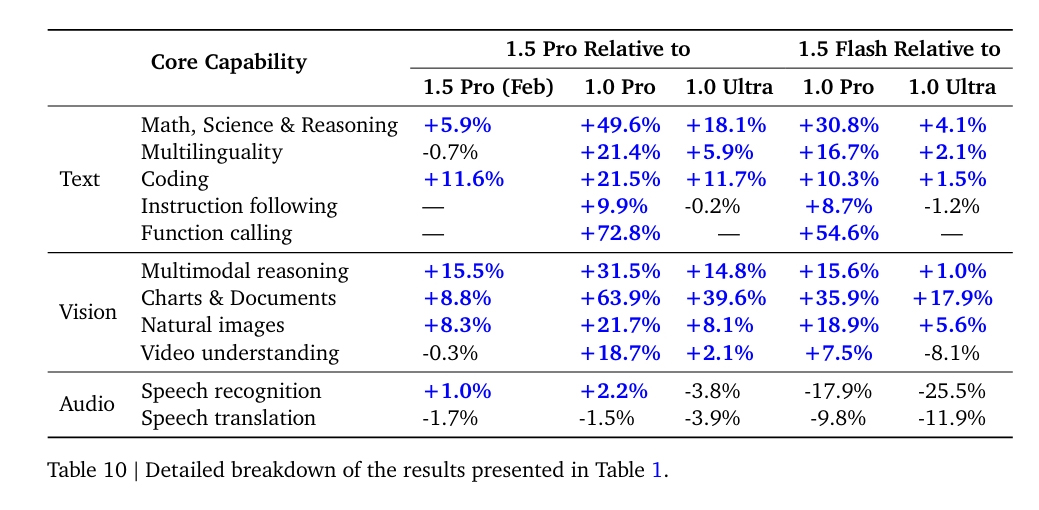

虽然 Google 没有公开 Gemini 1.5 Flash 的具体参数大小,但它在文本、视觉和音频等所有模态中均表现出色。根据 Google 发布的 Gemini 1.5 技术报告,Gemini 1.5 Flash 在很多方面都优于更大的 Gemini 1.0 Ultra 和 1.0 Pro 模型。只有在语音识别和翻译方面,Flash 模型稍逊于这些大型模型。

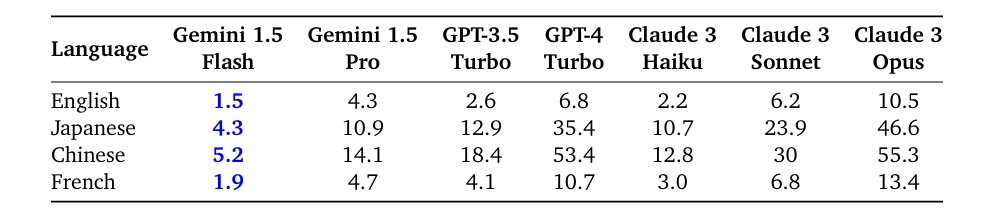

与采用稀疏 MoE(专家混合)模型的 Gemini 1.5 Pro 不同,Gemini 1.5 Flash 是一个密集型模型。它是从更大的 1.5 Pro 模型在线蒸馏而来,以提升性能质量。在速度方面,Flash 模型也超越了市场上所有小型模型,包括运行在 Google 定制 TPU 上的 Claude 3 Haiku。

Gemini 1.5 Flash 的价格也非常低廉。处理 128K Token 的费用仅为输入 $0.35 和输出 $0.53;处理 100 万 Token 的费用则为输入 $0.70 和输出 $1.05,比 Llama 3 70B、Mistral Medium、GPT-3.5 Turbo 等大型模型都要便宜很多。

如果你是开发者,需要一个成本低廉,同时拥有较大上下文窗口的模型进行多模态推理,那么 Gemini 1.5 Flash 绝对值得一试。

如何免费使用 Gemini 1.5 Flash

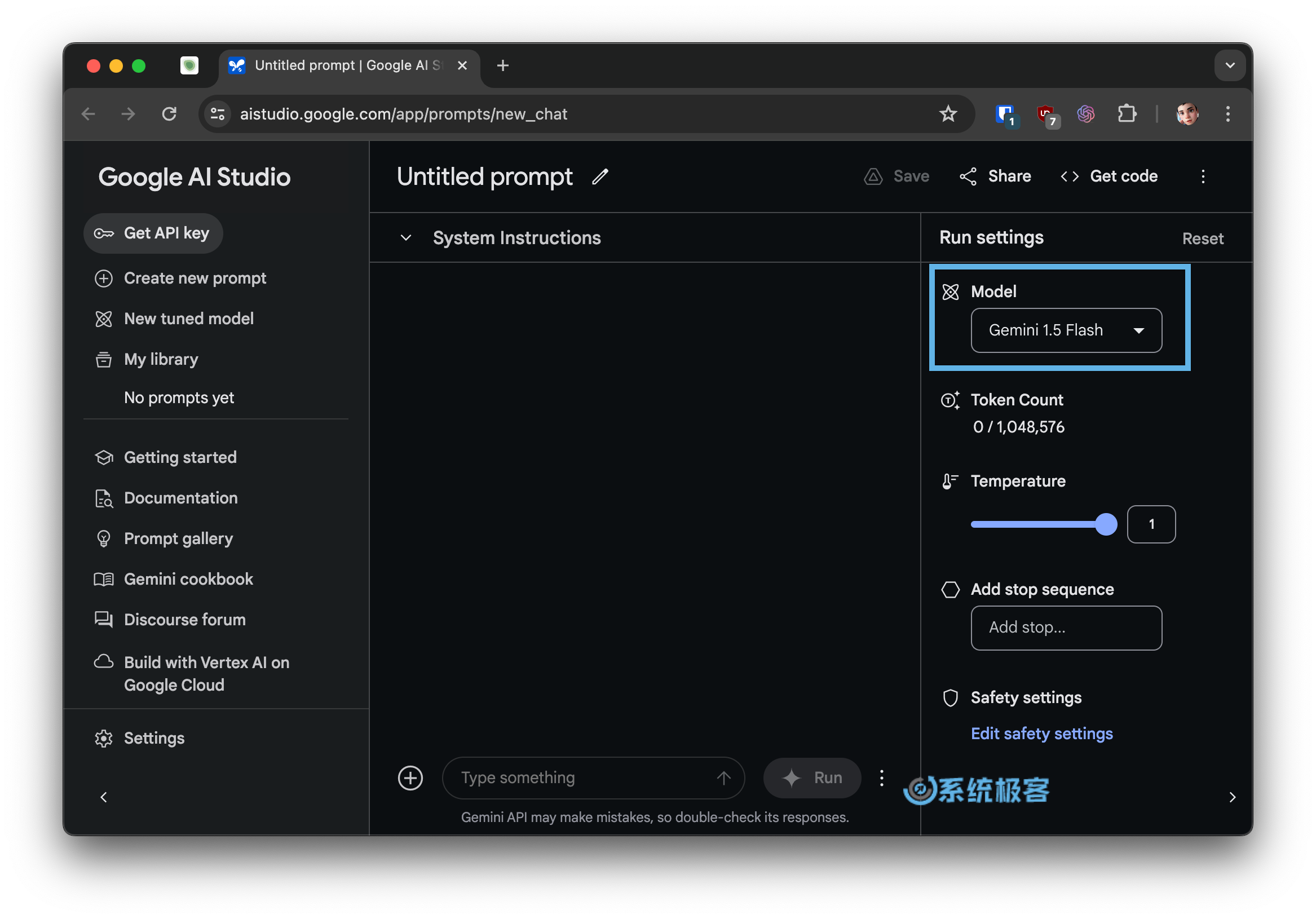

1访问 Google AI Studio,并登录你的 Google 账户。

2在下拉菜单中选择「Gemini 1.5 Flash」模型,就可以与 Flash 模型进行互动对话了。你还可以上传图片、视频、音频以及各种文件和文件夹。

你也可以通过 API 调用 Gemini 1.5 Flash。

虽然 Gemini 1.5 Flash 不是最先进的模型,但它的优势在于极快的速度、高效率和低成本。它在能力方面排在 Gemini 1.5 Pro 之下,但有望成为 GPT-4o 的强劲对手。

CPU 的一些事

CPU 的一些事 Linux 的一些事

Linux 的一些事 Microsoft PowerToys

Microsoft PowerToys Microsoft Sysinternals

Microsoft Sysinternals

最新评论

可以共存,但虚拟机维护起来更麻烦了呀。

关掉之后重启下系统再试试呢

不能共存吗?

我是家庭版,看着关掉了,但是破解程序一运行还是弹窗,搞不了